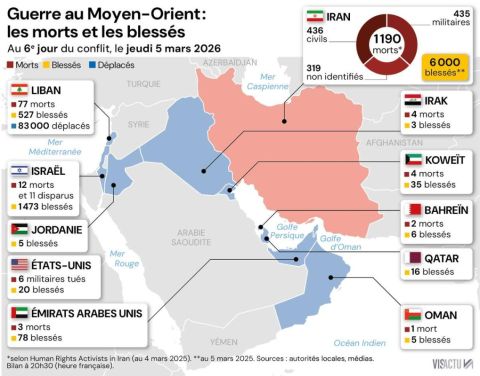

Drones autonomes, identification précise des cibles, analyse rapide de données : l'intelligence artificielle est désormais au cœur des opérations militaires. Lors de l'offensive américaine en Iran, plusieurs systèmes intégrant l'IA ont été mobilisés, accélérant ainsi les décisions tout en soulevant des questions éthiques cruciales.

Plus de 1.000 cibles ont été frappées en seulement 24 heures. Lors de cette offensive, l'intelligence artificielle a joué un rôle déterminant dans l'évaluation et la priorisation des objectifs militaires. L'usage de drones autonomes en Ukraine et l'identification de cibles à Gaza témoignent de l'intégration croissante de l'IA dans les conflits modernes. Selon des experts, ses capacités avancées, similaires à celles de ChatGPT, apportent des bénéfices notables à la planification des opérations.

Lors de l'opération Epic Fury, menée par les États-Unis en collaboration avec Israël, qui a conduit à la mort du guide suprême Ali Khamenei le 28 février, Washington s'est tourné vers la technologie Palantir. Ce logiciel d'analyse de données, propulsé par l'IA Claude développée par Anthropic, permet de traiter de très grandes quantités d'informations : rapports de mission, images satellites, communications interceptées, ainsi que simulations de scénarios. Il est désormais considéré comme un allié stratégique dans la conduite de la guerre.

"L'IA peut nuire aux valeurs démocratiques"

Selon David Rigoulet-Roze, chercheur à l'Institut français d'analyse stratégique (IFAS), "les Américains ont tiré parti du système Claude AI pour faciliter la sélection des cibles, en stockant d'énormes quantités de données, tant téléphoniques que géographiques. Cet outil optimise la gestion des données et influence directement la prise de décision". Toutefois, des voix s'élèvent pour questionner l'impact de ces technologies sur les valeurs démocratiques, soulignant le besoin d'un cadre éthique robuste dans leur utilisation.